Bản quyền và sự thật trong thời trí tuệ nhân tạo AI

Những người mê chụp ảnh di động nghiệp dư ắt thích thú với tính năng AI Trợ lý Chỉnh ảnh (Photo Assist) trong nền tảng Galaxy AI mà Samsung vừa trang bị đầu tiên trên dòng smartphone Galaxy S24 Series. Ứng dụng trí tuệ nhân tạo (AI), công cụ cho phép người dùng thay đổi kích thước, vị trí hoặc thậm chí loại bỏ các đối tượng trong ảnh. Người dùng cũng có thể tinh chỉnh bố cục ảnh, nâng cấp bất kỳ bức ảnh nào nhanh chóng và dễ dàng ngay lập tức với tính năng Gợi ý Chỉnh sửa (Edit Suggestion). Người dùng cũng có thể sử dụng công cụ Xóa phản chiếu (Erase Reflection) để tự động loại bỏ bóng đổ và phản chiếu ánh sáng không mong muốn. Và với những hình ảnh đã được AI can thiệp, Samsung gắn lên đó một hình mờ watermark cho biết đó là hình ảnh được tạo bởi AI.

Phải nói rằng, sau khi công ty khởi nghiệp OpenAI tung ra ứng dụng AI đầu tiên là ChatGPT hồi cuối năm 2022, kích hoạt làn sóng đua nhau phát triển các ứng dụng AI, đặc biệt là với AI tạo sinh (generative AI), thế giới mừng đó mà cũng lo đó. Khả năng sáng tạo “kinh hồn bạt vía” của AI rõ ràng sẽ giúp ích con người rất nhiều trong mọi lĩnh vực của cuộc sống. Nhưng mặt trái là nó càng làm cho tình trạng hỗn mang của thế giới thêm trầm trọng hơn. Người ta sẽ phải sống trong một xã hội thật giả lẫn lộn, trong cái thật không biết có bao nhiêu phần trăm cái giả, dễ bị lừa hơn, luôn có cảm giác nghi ngờ không biết cái nào do AI tạo ra.

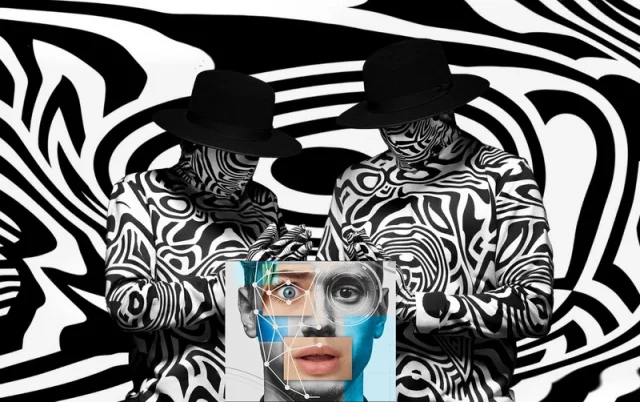

Deepfake. (Ảnh: Internet. Thanks.)

Đơn cử như chiêu trò “lộng giả thành chân” Deepfake. Từ nhiều năm nay, thế giới đã lâm vào tình cảnh khốn đốn và chịu nhiều thiệt hại khi bọn tội phạm công nghệ ứng dụng AI để tạo ra những video clip giả mạo với những hình ảnh và giọng nói của người thật mà chúng mạo danh. Theo Báo cáo Gian lận Danh tính (Identity Fraud Report) 2023 do Sumsub công bố hồi cuối tháng 11-2023, các vụ lừa đảo Deepfake trên toàn cầu đã tăng gấp 10 lần từ năm 2022 đến năm 2023. Xin lưu ý, đây cũng là thời gian thế giới bùng nổ các ứng dụng AI tạo sinh. Status Labs nói rằng Deepfake đã gây ảnh hưởng lớn đến văn hóa, quyền riêng tư và thanh danh cá nhân. Phần lớn tin tức và sự chú ý xung quanh Deepfake tập trung vào các video khiêu dâm của người nổi tiếng, nội dung khiêu dâm trả thù, thông tin sai lệch và trò lừa bịp, tin tức giả mạo, tống tiền và lừa đảo. Chẳng hạn, hồi năm 2019, một công ty năng lượng ở Mỹ đã bị lừa 243.000 USD do kẻ xấu giả mạo hình ảnh, giọng nói của lãnh đạo công ty yêu cầu nhân viên chuyển tiền cho đối tác. Hãng tin REUTERS cho biết trong năm 2023, có khoảng 500.000 nội dung Deepfake dạng video và tiếng nói đã được chia sẻ qua các mạng xã hội trên thế giới. Bên cạnh những Deepfake để đùa vui là những cái do bọn xấu tạo nên để lừa đảo cộng đồng. Có nguồn cho biết, trong năm 2022, ước tính các vụ lừa đảo Deepfake trên thế giới đã gây thiệt hại đến 11 triệu USD.

Râm ran từ lâu, và sau khi ứng dụng AI như ChatGPT bắt đầu được phổ cập rộng rãi, người ta đã cảnh báo về những mặt trái mà công nghệ AI sẽ gây ra. Trong đó, nổi cộm là vấn đề bản quyền sở hữu trí tuệ và tính thật giả.

Ứng dụng trí tuệ nhân tạo AI. (Ảnh được tạo bởi AI Microsoft Designer DALL-E 3). Thanks.

Trong phạm vi bài viết này, chúng ta chưa bàn tới viễn cảnh xảy ra những vụ tranh chấp bản quyền sở hữu trí tuệ giữa các “tác phẩm” do AI tạo ra. Chẳng hạn, ông A. nhờ một ứng dụng AI vẽ giùm một bức tranh với chủ đề nào đó, trong khi cô B cũng nhờ ứng dụng AI đó làm tương tự, và kết quả là cho ra những bức tranh có những nét tương đồng. Vậy là rất dễ xảy ra tranh chấp về quyền sở hữu. Cho đến nay vẫn còn quá sớm để các nước quyết định về việc công nhận bản quyền đối với các nội dung do AI tạo ra (công nhận quyền tác giả cho các cá nhân đặt hàng AI sáng tạo hay các công ty phát triển ứng dụng AI).

Ở đây, chúng ta đặt ra vấn đề về việc những nội dung do AI tạo ra có thể vi phạm bản quyền hay không? Về công nghệ, các nội dung do AI tạo ra được thuật toán tổng hợp từ các dữ liệu mà nó đã được huấn luyện. Và cơ sở dữ liệu này được các nhà phát triển ứng dụng AI thu thập từ nhiều nguồn, chủ yếu là từ kho tàng kiến thức toàn cầu Internet. Vấn đề là trong kho tàng Internet đó lại có nhiều tác phẩm đã được cấp bản quyền cho chủ sở hữu mà ai dùng chúng là vi phạm bản quyền.

Nổi bật hiện nay là vụ báo Mỹ The New York Times ngày 27-12-2023 đã khởi kiện 2 công ty OpenAI (với ChatGPT) và Microsoft vì cho rằng hàng triệu bài báo của họ đã được sử dụng để huấn luyện các chatbot AI và các nền tảng AI của 2 công ty này. Bằng chứng là có những nội dung do các chatbot tao ra theo yêu cầu người dùng lại giống hay tương tự nội dung trong các bài báo. Ai cũng hiểu, The Times không thể làm ngơ khi “tài sản trí tuệ” của mình bị các hãng khác sử dụng để thu lợi. OpenAI hiện được các nhà đầu tư định giá hơn 80 tỷ USD. Microsoft đã cam kết đầu tư 13 tỷ USD cho OpenAI và đã tích hợp công nghệ của công ty này vào công cụ tìm kiếm Bing của mình.

The New York Times là tờ báo lớn đầu tiên của Mỹ khởi kiện về bản quyền có liên quan đến AI. Người ta tin rằng, trong thời gian tới sẽ có thêm những tờ báo khác tham gia, nhất là sau khi The Times thành công. Trước đó, OpenAI đã đạt được thỏa thuận cấp phép bản quyền với hãng tin Associated Press hồi tháng 7-2023, và Axel Springer – nhà xuất bản Đức sở hữu hai báo Politico và Business Insider – vào tháng 12-2023.

Trong khi đó, nữ diễn viên Sarah Silverman đã tham gia một vài vụ kiện hồi tháng 7-2023 cáo buộc Meta và OpenAI sử dụng cuốn hồi ký của cô làm văn bản đào tạo cho các chương trình AI. Các nhà tiểu thuyết bày tỏ sự cảnh giác khi có thông tin tiết lộ rằng các hệ thống AI đã hấp thụ hàng chục nghìn cuốn sách thành cơ sở dữ liệu cho mình, dẫn đến vụ kiện của các tác giả bao gồm Jonathan Franzen và John Grisham. Hãng dịch vụ ảnh Getty Images cũng đã kiện một công ty AI tạo ra hình ảnh dựa trên lời nhắc bằng văn bản do sử dụng trái phép các tài liệu hình ảnh có bản quyền của Getty.

Đó là lý do mà người dùng có thể vướng phải những rắc rối về bản quyền khi “vô tư” sử dụng các “tác phẩm” mà mình đã nhờ vả các công cụ AI “sáng tác” giùm mình. Các nhà chuyên môn luôn khuyến cáo chỉ nên sử dụng các công cụ AI để giúp mình tra cứu, thu thập dữ liệu, gợi ý mang tính tham khảo.

Ở một vấn đề khác, ứng dụng AI gây rối trí cho người dùng khi không thể phân biệt được tính thật giả của một nội dung nào đó. Các nhà xuất bản và các tòa soạn báo chí bị rối khi tiếp nhận bản thảo tác phẩm. Các giáo viên cũng gặp khó khi không biết trong bài làm của học sinh có sử dụng AI hay không. Nghiêm trọng nhất là cộng đồng rộng rãi giờ đây sẽ phải cảnh giác cao hơn và thường xuyên hơn khi không biết nội dung nào là thật hay giả. Nhìn vào một tấm ảnh, người bình thường khó lòng phát hiện nó có bị AI “bùa phép” chỉnh sửa hay không.

Tất nhiên dĩ độc trị độc, rồi sẽ có những công cụ ứng dụng chính AI để phát hiện sự can thiệp của AI trong các nội dung. Và phải chăng, nhà chức trách cũng cần sớm có những quy định pháp lý rõ ràng và cụ thể về việc sử dụng ứng dụng AI tạo ra những nội dung riêng. Chẳng hạn như quy định phải thể hiện cho mọi người biết nội dung, tác phẩm đã được AI chỉnh sửa – giống như mặc định gắn dấu mờ watermark lên hình ảnh đã “qua tay” AI.

- Bài in trên báo Người Lao Động thứ Tư 28-2-2024 và trên báo NLĐ Online.

ANH PHÚC